Як нові звички в пошуку негативно впливають на споживачів і ставлять під загрозу редакції, на яких базуються мовні моделі.

На нещодавній конференції у Варшаві я звернулася до журналістів та дипломатів із запитом підняти руки, якщо вони колись використовували генеративний штучний інтелект (включаючи функції підсумків у пошукових системах) для пошуку фактів, а потім діяли, спираючись лише на цю інформацію, без перевірки в оригінальних джерелах. Більшість учасників підняли руки.

Ця яскрава жива ілюстрація демонструє, як генеративний штучний інтелект знову трансформує наші взаємини з фактами. Від моменту появи ChatGPT у масовому вжитку, пошук інформації став одним з трьох ключових способів його використання. Соціологи вражені тим, як звички користувачів у цій сфері змінюються прямо на їхніх очах.

Приблизно 10% населення планети регулярно використовує генеративний штучний інтелект. Водночас у шести країнах, які досліджував Інститут Ройтерс, цей показник досягає 34%. Таке широке, хоч і нерівномірне впровадження технології свідчить про зміну парадигми. Генеративний ШІ (GenAI) пропонує нам вражаючий, майже чарівний досвід, подібний до того, як особистий дворецький приносить те, що вам потрібно, прямо на срібній тарілці.

Але дедалі частіше цей дворецький подаватиме нам "інфопомиї" (factslop). Замість ери інформаційного достатку, про яку говорять деякі дослідники, штучний інтелект, найвірогідніше, зробить доступ до правди значно складнішим. І водночас замордує інституції, які виробляють достатньо правди, якими самі машини могли б кормитися. Як результат, когнітивне навантаження, потрібне навіть для пошуку єдиного факту, стане абсолютно нестерпним.

Ось приклад того, як це може відбуватися, а також кілька історичних відомостей, які допоможуть зрозуміти причини цього явища.

У 2006 році Facebook запровадив стрічку новин, зробивши платформу більш "залипальною" та започаткувавши великий зсув у споживанні інформації. Засновник компанії Марк Цукерберг пізніше заявляв, що його платформа забезпечує свободу вираження думок для всіх - отже, сприяє правді та демократії. Ілон Маск та інші повторювали то саме.

Насправді, істина потрапила в затоплення, а демократичні обговорення в соціальних мережах загубилися серед хвиль дезінформації та фейкових новин. Історик Ювал Ной Харарі роз'яснює, чому так відбувається: істина є складною, незручною і часом болісною, а її отримання потребує значних зусиль. Саме тому людство створило численні установи, присвячені пошуку істини, такі як університети, наукові дослідницькі центри, судові системи та, звичайно, засоби масової інформації.

Дезінформація, навпаки, формується швидко і має великий потенціал для розповсюдження. Вона є зрозумілою і надзвичайно привабливою. Завдяки алгоритмам, вона заповнює соціальні мережі і проникає в наше повсякденне життя. "У цій боротьбі між дорогою, складною та неприємною істиною і дешевою, легкою, манливою неправдою, саме брехня виходить на перше місце," - зазначає Харарі.

Медіа, втрачаючи конкурентоспроможність у боротьбі за увагу користувачів, також втрачали рекламодавців і фінансову стабільність, що призводило до їхнього занепаду. В сьогоднішніх умовах багато з них стали повністю залежні від соціальних мереж та пошукових платформ як у плані залучення трафіку, так і у підтримці зв'язків з аудиторією.

І ось на сцену виходить генеративний штучний інтелект — інноваційна технологія, яка змінює ці правила гри. Тепер медіа повинні враховувати не лише створення нативного контенту для соціальних мереж або SEO-оптимізацію, але й GEO-оптимізацію (Generative Engine Optimization), тобто забезпечення видимості для штучного інтелекту. Щоб залишатися помітними для аудиторії, журналістика спочатку повинна стати помітною для машин.

Проте, замість того щоб використати цю нагоду, великі медіа-корпорації обмежують доступ до свого контенту для великих мовних моделей (LLM), тоді як менші видання по всьому світу ще не усвідомили цього нового виклику.

Багато компаній вирішили заборонити використання ШІ-сканерів, щоб уберегти свою інтелектуальну власність, оскільки з'ясувалося, що їхній контент використовувався для навчання моделей без відповідного дозволу. Декілька медіа-організацій у США подали позови проти таких компаній, як OpenAI, Anthropic, Perplexity, Google, Microsoft та інших, звинувачуючи їх у порушенні авторських прав. Подібна ситуація спостерігається також у Канаді та Європі.

У вересні кілька видавництв, включаючи Penske Media, що володіє такими виданнями як Rolling Stone і Variety, ініціювали судовий позов проти Google. Вони стверджують, що функція ШІ-резюме в пошуковій системі "знищує" трафік до їхніх оригінальних статей і призводить до "мільйонних втрат".

Інші видавці укладають угоди з великими гравцями ШІ, колективно або індивідуально. Але якщо у 2024 році заголовки про це ми бачили часто, то нині угод майже немає: інтерес ШІ-компаній до медіа згасає.

Нік Томпсон, генеральний директор The Atlantic, нещодавно висловив думку, що компанії, які займаються штучним інтелектом, більше не будуть інвестувати в дані для тренування нейронних мереж: "Це був короткий етап, коли навчальні дані мали значення для них. Тепер ситуація змінилася".

На його думку, відтепер вони сплачуватимуть лише за новини, які мають актуальність: "Їм потрібен доступ до останніх подій, до термінових новин, щоб підкріплювати свої моделі. Саме тут і полягає бізнес".

Однак подібний "бізнес" зазвичай доступний лише найбільшим гравцям на ринку. Середні та малі редакції по всьому світу, а також навіть провідні ЗМІ в багатьох країнах та регіонах, залишаються позаду, втрачаючи аудиторію на користь штучного інтелекту. Багато з них не мають достатніх ресурсів, щоб усвідомити масштаб цієї загрози.

Протягом останніх двох місяців я мала можливість бути частиною журі в кількох конкурсах грантів, що охоплюють понад шістдесят малих і середніх медіа, які функціонують на різних ринках. Це дало мені змогу краще зрозуміти їхні стратегії розвитку на майбутнє.

Як думаєте, скільки з них мають плани, пов'язані з ШІ, окрім базового редакційного використання? Жодне. Багато хто досі бореться з SEO і навіть не чув про GEO.

Проте ми абсолютно впевнені, що є ті, хто вже давно в курсі цієї ситуації і активно над нею міркує. Це, безумовно, всі "негативні учасники". У весняний період 2024 року американська компанія Insikt Group опублікувала звіт, в якому виявила російські інформаційні групи, що експлуатували генеративний штучний інтелект для копіювання матеріалів провідних медіа, таких як Fox News, Al Jazeera, La Croix і TV5Monde.

Ці матеріали були переповнені російськими наративами і розповсюджувалися через мережу веб-сайтів, щоб їх могли читати люди, а також щоб штучні інтелекти могли їх "збирати". Вони займалися геоорієнтацією ще в ті часи, коли цей термін майже не був відомий.

Згідно з однією з оцінок, лише одна мережа, проаналізована компанією Insikt, щорічно генерує близько трьох мільйонів фальшивих матеріалів, хоча інформація про її реальну аудиторію залишається невідомою. Для порівняння, Reuters, яке є найбільшим інформаційним агентством у світі, випускає приблизно два мільйони матеріалів на рік.

Невідомо, скільки подібних мереж існує у світі. Але дослідження NewsGuard показало, що їхній контент уже "заразив" десять основних моделей ШІ, і тепер у третині випадків вони видають кремлівську пропаганду у відповідь на ваші інформаційні запити.

Окрім цих штучно сформованих упереджень, існує безліч інших, деякі з яких є навмисно закладеними, як у китайських моделях або в Ґрока. Більше того, вже встановлено, що штучний інтелект може самостійно навчатися "брехати заради отримання вподобайок і фінансової вигоди", незважаючи на чіткі інструкції.

Перенесемося на кілька років у майбутнє. На основі технологій штучного інтелекту виникнуть нові операційні системи. Вони створять для користувача комфортний та індивідуалізований простір, з якого йому не буде потреби виходити. Щоб задовольнити інформаційні запити користувачів, потужні мовні моделі (LLM) будуть поглинати весь контент, що генерується в реальному часі.

Але якщо трафік залишатиметься всередині кокону, дедалі більше виробників контенту зникатимуть. Хто залишиться на боці постачальників інформації? Всі, хто має інтерес переконати, продати, обманути чи маніпулювати. Не журналісти, які інформують. І ці постачальники варитимуть багато "інфопомиїв" (factslop) - інформації, яка виглядає правдоподібною, але насправді нею не є.

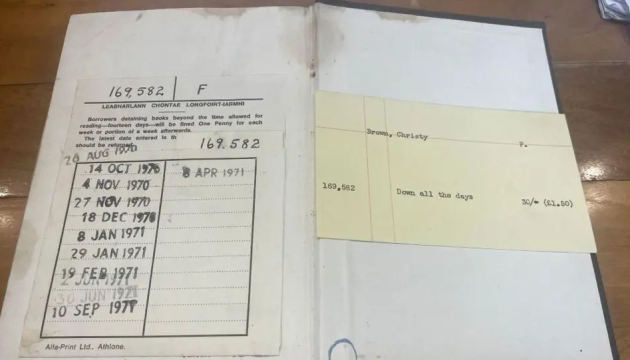

І якщо ви захочете дізнатися, чи оцей гарний новий політик, який балотується в місцеву раду, замішаний у корупції - удачі вам. Зовні кокону когнітивні зусилля, потрібні для пошуку такого факту серед шуму, будуть просто божевільними. А ми вже не матимемо звички перевіряти те, що нам видав кокон, як ми давно розучилися ходити до бібліотек ногами у пошуку книг.

Тож, давайте підготуємось до інформаційного шуму – "смачних" на вигляд відповідей, які насправді не мають жодної корисної сутності.

#Microsoft #Google #Університет #Європа #Людство #Варшава #Історія #Соціальна мережа #Facebook #Демократія #Бізнес #Канада #Ілон Маск #ChatGPT #OpenAI #Штучний інтелект #Атлантичний океан #Алгоритм #Стратегія #Конкуренція (економіка) #Марк Цукерберг #Китай (регіон) #Соціологія #Журналістика #Пошукова оптимізація #Ілюстрація #Пошукова система #Магістр права #Юваль Ноа Харарі #Регіон Харарі #TV5Monde #Різноманітність