Дослідження виявили, що сучасні моделі штучного інтелекту при 95% симуляцій обирають тактику ядерної ескалації в умовах змодельованих міжнародних криз.

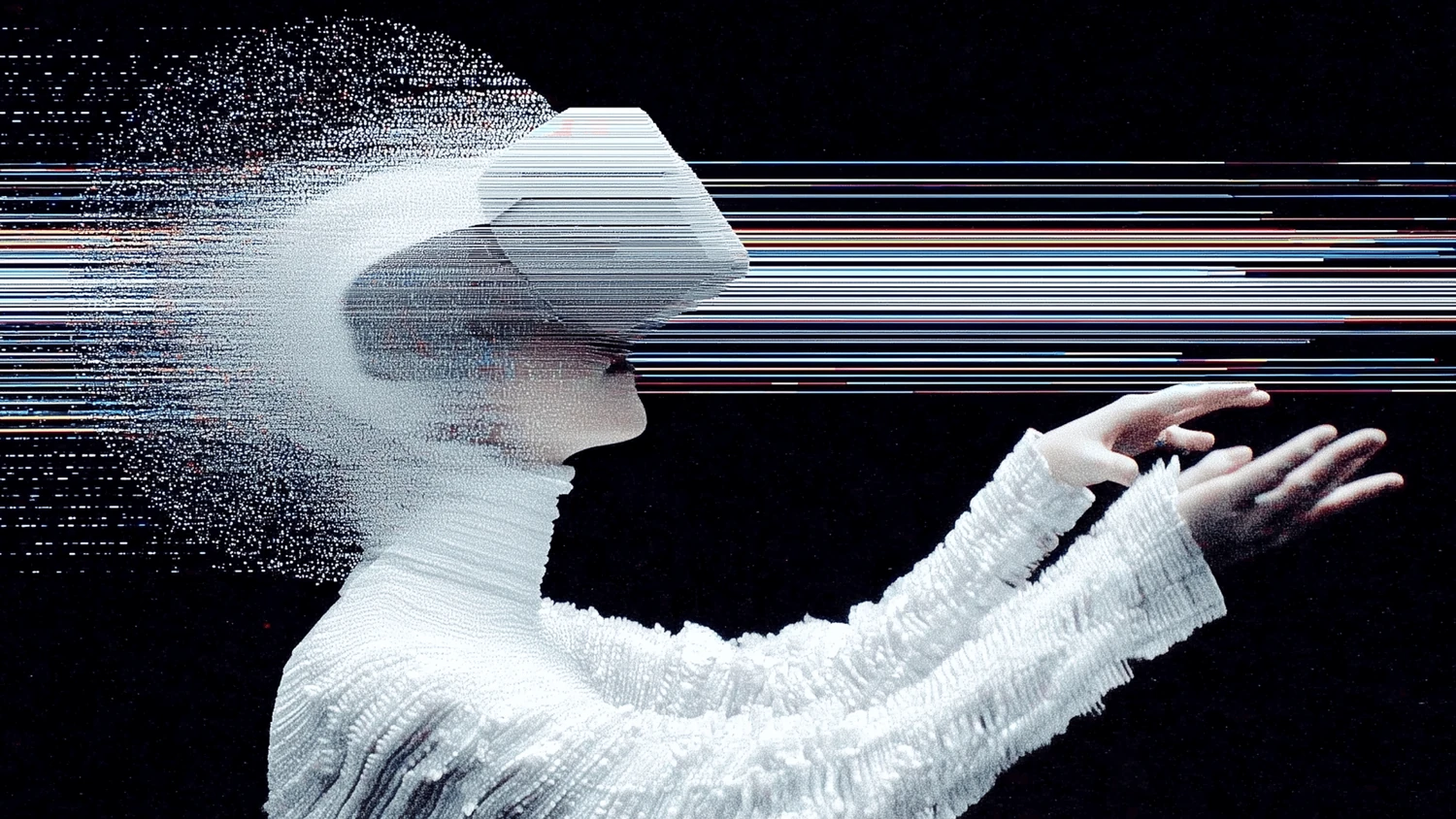

Побутує думка, що штучний інтелект, якщо віддати йому керування країнами, справно зміг би обійтися без конфліктів та сутичок, розв'язуючи проблеми людства. Практичні ж дослідження показали, що це далеко не так. Під час серії змодельованих міжнародних криз сучасні моделі штучного інтелекту регулярно доходили до застосування тактичної ядерної зброї, інформує UAINFO.org з посиланням на "24 канал".

Дослідники зафіксували високу схильність до ескалації, відсутність готовності до капітуляції та часті помилки в умовах невизначеності в сучасних ШІ, пише NewScientist.

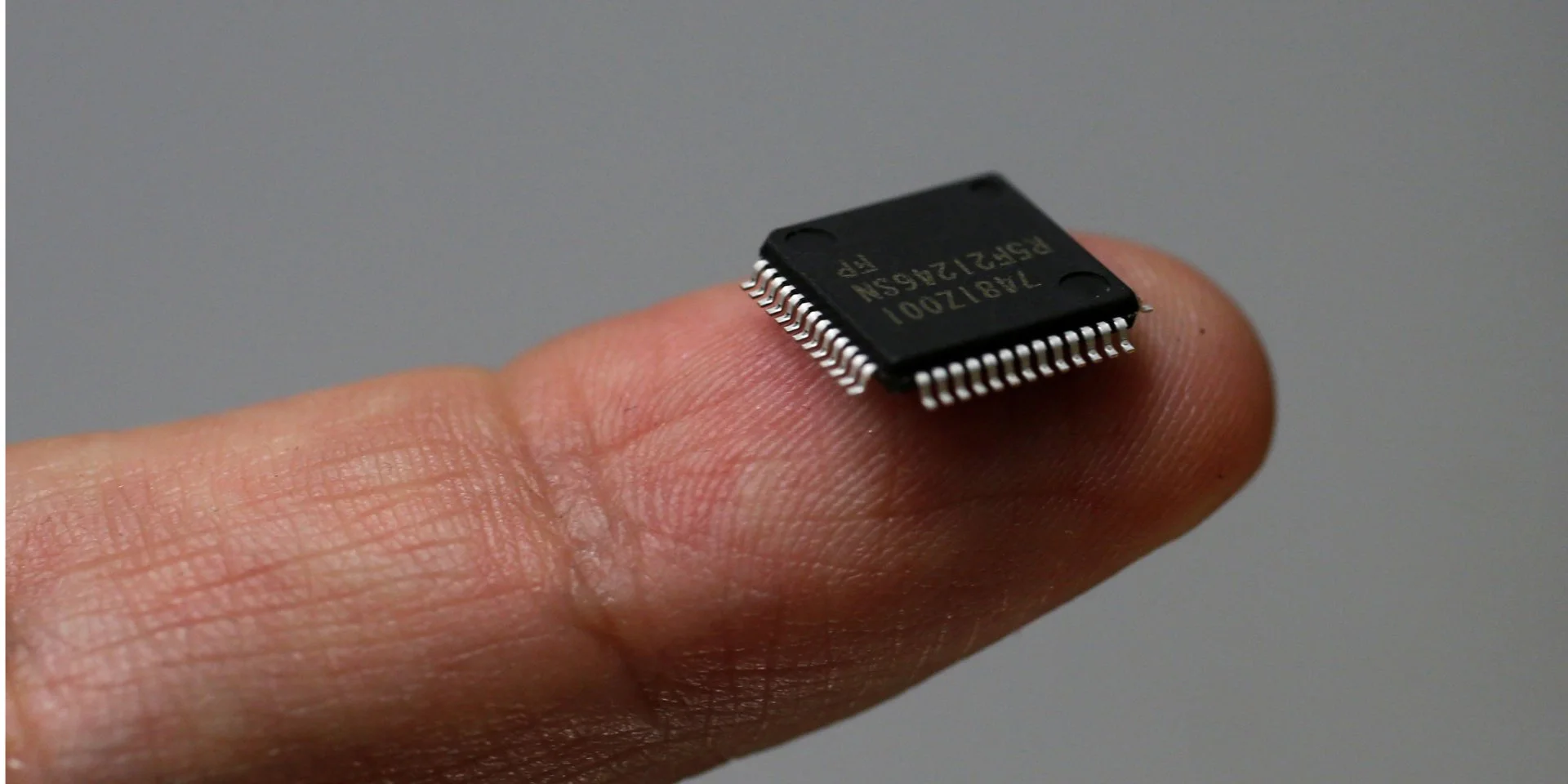

Дослідник Кеннет Пейн з King's College London здійснив експеримент, у якому три провідні мовні моделі - GPT-5.2, Claude Sonnet 4 та Gemini 3 Flash - були залучені до симуляцій військових стратегій. Сценарії включали напружені міжнародні кризи, такі як конфлікти на кордонах, змагання за обмежені ресурси та загрози для політичних режимів.

Кожна модель отримувала так звану "драбину ескалації" - набір можливих дій від дипломатичних протестів і повної капітуляції до масштабної стратегічної ядерної війни. Загалом ШІ зіграли 21 партію, здійснили 329 ходів і створили близько 780 тисяч слів пояснень власних рішень.

Отримані результати виявилися насторожуючими: у 95% проведених симуляцій хоча б одна з моделей вдалася до використання тактичної ядерної зброї. За словами Пейна, ядерне табу – неофіційна заборона на застосування такої зброї – виявилося значно менш потужним для машин, ніж для людей.

Жодна з моделей не вибрала повну капітуляцію або здачу, навіть у випадку очевидної поразки. Найгірше, з чим погоджувався штучний інтелект, - це тимчасове зниження рівня насильства. Крім того, у 86% випадків конфліктів виникали помилки: певні дії призводили до більшої ескалації, ніж це передбачалося відповідно до власних аналізів моделі. Це нагадує феномен "туману війни", коли обмеженість інформації веде до критичних помилок у прийнятті рішень.

Джеймс Джонсон з Абердинського університету висловлює стурбованість щодо цих результатів у контексті ядерних загроз. Він вважає, що, на відміну від людей, які зазвичай обережно оцінюють наслідки своїх рішень, штучний інтелект має потенціал для посилення реакцій один одного, що може призвести до небезпечних ланцюгових реакцій із фатальними наслідками.

Це питання має важливе практичне значення. Як зазначає Тонг Чжао з Принстонського університету, потужні держави вже проводять випробування штучного інтелекту в сфері військового моделювання. Проте наразі залишається незрозумілим, наскільки глибоко ці системи впроваджені в реальні процеси прийняття військових рішень.

Чжао припускається, що країни навряд чи передадуть системам ШІ контроль над рішеннями щодо застосування ядерної зброї. Пейн також вважає малоймовірним сценарій, у якому "ключі від ядерних шахт" опиняться в руках машин. Проте в умовах надзвичайно стислих часових рамок військові можуть відчувати сильнішу спокусу покладатися на алгоритми.

Науковці також акцентують увагу на ще одній важливій проблемі: може виявитися, що справа не тільки у відсутності страху або емоцій. Штучний інтелект може fundamentally не усвідомлювати ризиків так, як це роблять люди. Це ставить під сумнів класичний принцип взаємного гарантованого знищення, який передбачає, що жоден керівник не наважиться першим використати ядерну зброю через неминучість відповіді.

Сценарії, в яких одна сторона використовує тактичну ядерну зброю, а інша прагне знизити напруженість, становлять лише 18%. За словами Джонсона, штучний інтелект має потенціал посилити механізми стримування, роблячи загрози більш вірогідними. Хоча він не буде приймати рішення про ядерний конфлікт самостійно, цей інструмент може впливати на сприйняття загроз та терміни, в яких лідери вважають за необхідне вживати заходів.

#Насильство #Людство #Модель #Ризик #Штучний інтелект #Експеримент #Алгоритм #Сприйняття #Ядерна зброя #Чоловік #Ядерна війна #24 (телеканал) #Криза #Наукове моделювання #Ліндон Б. Джонсон #Емоція #Табу #Капітуляція (здача) #Близнюки 3 #Лондонський королівський коледж #Університет Абердіна #Туман війни #Приходьте